Transport optimal, EDP et optimisation

applications en sciences des données

Programme Liste des participants

CIMPA School

Le projet a pour but d'initier les doctorants et les jeunes chercheurs à quelques techniques mathématiques modernes pour le traitement théorique et numérique des données, qu'ils soient signal, image, graphes et réseaux ou nuages de points, etc. La théorie du transport optimal de masse (TOM) sera mise en avant afin d'initier les jeunes chercheurs à cette thématique moderne à l'interface entre l'optimisation, les EDP et les probabilités. Elle permet de traiter une large gamme de problèmes d'applications. Pour dynamiser et booster les activités de recherche locales, des applications modernes dans le domaine d'imagerie numériques, graphes et réseau seront largement traitées. Avant d'entamer les thématiques avancées de l’école qui touchent à la fois à la théorie, le numérique et les applications, nous prévoyons des cours introductifs de niveau Master accompagnés de TP autour de l'optimisation, l'image, les données et des logiciels de programmation. Des séances de TP encadrées seront organisées pour illustrer et mettre en œuvre certaines méthodes numériques des cours avancés.

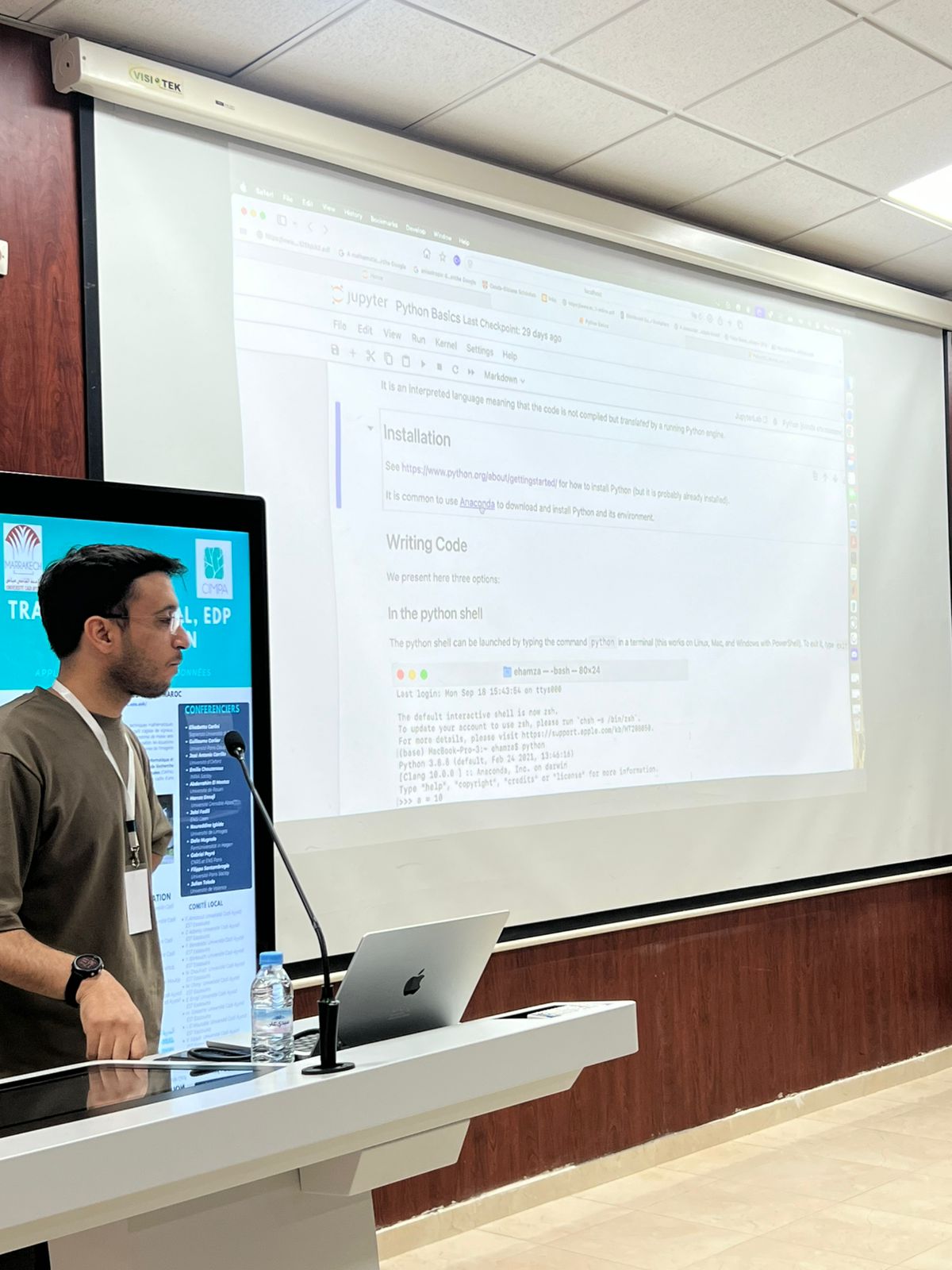

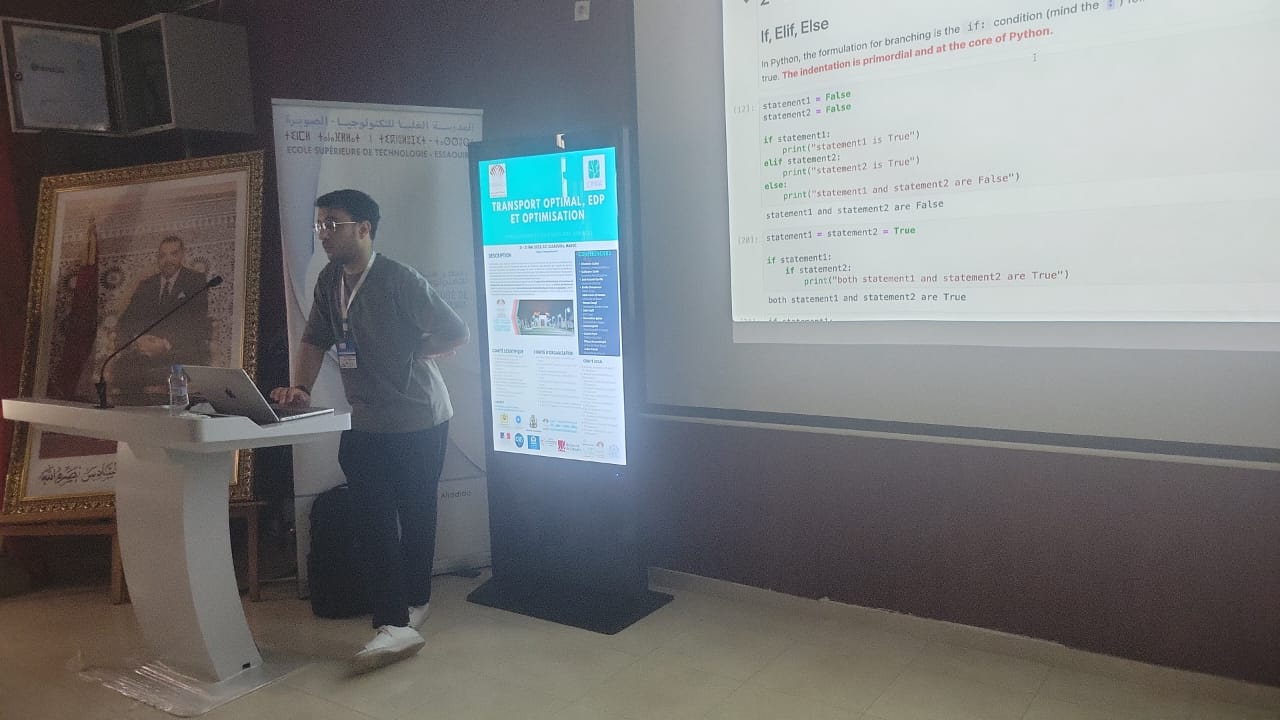

Le langage Python suffit pour la plupart des besoins en mathématiques appliquées et permet de réaliser beaucoup plus rapidement des programmes informatiques qui fonctionnent sur les principaux systèmes d'exploitation. Le but de ce cours (suivis de TP) étant de donner les principes de bases de ce langage ainsi que ses différentes possibilités pour faire du calcul scientifique, des jeux ou encore des sites Internet moyennant son large panel de librairies.

Le but de ces séances de TP est de pratiquer le langage Python sur des exemples simples afin de toucher ses différentes possibilités de faire du calcul scientifique, des jeux ou encore des sites Internet moyennant son large panel de librairies

This course introduces Semi-Lagrangian (SL) schemes as a tool for the numerical solution of Hamilton-Jacobi (HJ) equations and optimal control problems. SL schemes are based on the method of characteristics, tracing the flow of information within the equation. An overview of optimal control problems will be presented, including formulations with finite and infinite horizons, the Dynamic Programming Principle, and viscosity solutions.

Numerical methods based on SL schemes will then be illustrated, starting with the linear transport equation and extending the analysis to solving HJ equations.

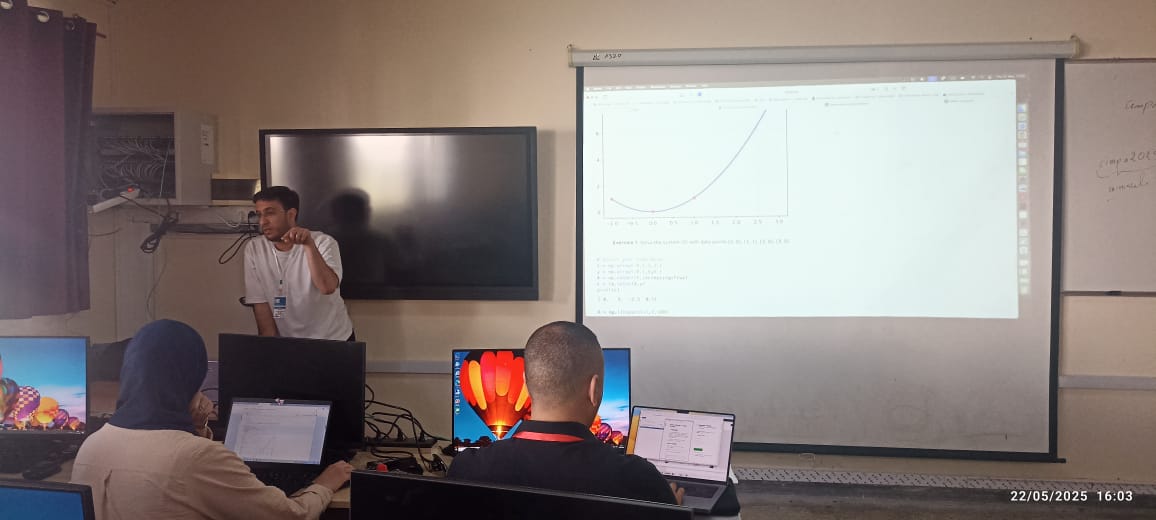

Le but de ce cours est de donner/rappeler des outils théoriques, les concepts et les algorithmes classiques en optimisation différentiable et non différentiable (avec et sans contraintes), et enfin donner quelques méthodes numériques d'optimisation

Ces séances feront suite au cours introductif sur l'optimisation. Le but étant de pratiquer quelques méthodes numériques d'optimisation.

Le langage Python suffit pour la plupart des besoins en mathématiques appliquées et permet de réaliser beaucoup plus rapidement des programmes informatiques qui fonctionnent sur les principaux systèmes d'exploitation. Le but de ce cours (suivis de TP) étant de donner les principes de bases de ce langage ainsi que ses différentes possibilités pour faire du calcul scientifique, des jeux ou encore des sites Internet moyennant son large panel de librairies.

Le but de ces séances de TP est de pratiquer le langage Python sur des exemples simples afin de toucher ses différentes possibilités de faire du calcul scientifique, des jeux ou encore des sites Internet moyennant son large panel de librairies

Le langage Python suffit pour la plupart des besoins en mathématiques appliquées et permet de réaliser beaucoup plus rapidement des programmes informatiques qui fonctionnent sur les principaux systèmes d'exploitation. Le but de ce cours (suivis de TP) étant de donner les principes de bases de ce langage ainsi que ses différentes possibilités pour faire du calcul scientifique, des jeux ou encore des sites Internet moyennant son large panel de librairies.

Le but de ces séances de TP est de pratiquer le langage Python sur des exemples simples afin de toucher ses différentes possibilités de faire du calcul scientifique, des jeux ou encore des sites Internet moyennant son large panel de librairies

Le but de ce cours est de donner/rappeler des outils théoriques, les concepts et les algorithmes classiques en optimisation différentiable et non différentiable (avec et sans contraintes), et enfin donner quelques méthodes numériques d'optimisation

Ces séances feront suite au cours introductif sur l'optimisation. Le but étant de pratiquer quelques méthodes numériques d'optimisation.

Le but de ce cours est de donner/rappeler des outils théoriques, les concepts et les algorithmes classiques en optimisation différentiable et non différentiable (avec et sans contraintes), et enfin donner quelques méthodes numériques d'optimisation

Ces séances feront suite au cours introductif sur l'optimisation. Le but étant de pratiquer quelques méthodes numériques d'optimisation.

This course introduces Semi-Lagrangian (SL) schemes as a tool for the numerical solution of Hamilton-Jacobi (HJ) equations and optimal control problems. SL schemes are based on the method of characteristics, tracing the flow of information within the equation. An overview of optimal control problems will be presented, including formulations with finite and infinite horizons, the Dynamic Programming Principle, and viscosity solutions.

Numerical methods based on SL schemes will then be illustrated, starting with the linear transport equation and extending the analysis to solving HJ equations.

This course introduces Semi-Lagrangian (SL) schemes as a tool for the numerical solution of Hamilton-Jacobi (HJ) equations and optimal control problems. SL schemes are based on the method of characteristics, tracing the flow of information within the equation. An overview of optimal control problems will be presented, including formulations with finite and infinite horizons, the Dynamic Programming Principle, and viscosity solutions.

Numerical methods based on SL schemes will then be illustrated, starting with the linear transport equation and extending the analysis to solving HJ equations.

This course provides a concise introduction to the theory of gradient flow dynamics in Hilbert spaces and more general metric spaces. We will delve into the fundamental concepts, properties, and applications of gradient flows, exploring their role in understanding the evolution of systems governed by nonlinear PDEs.

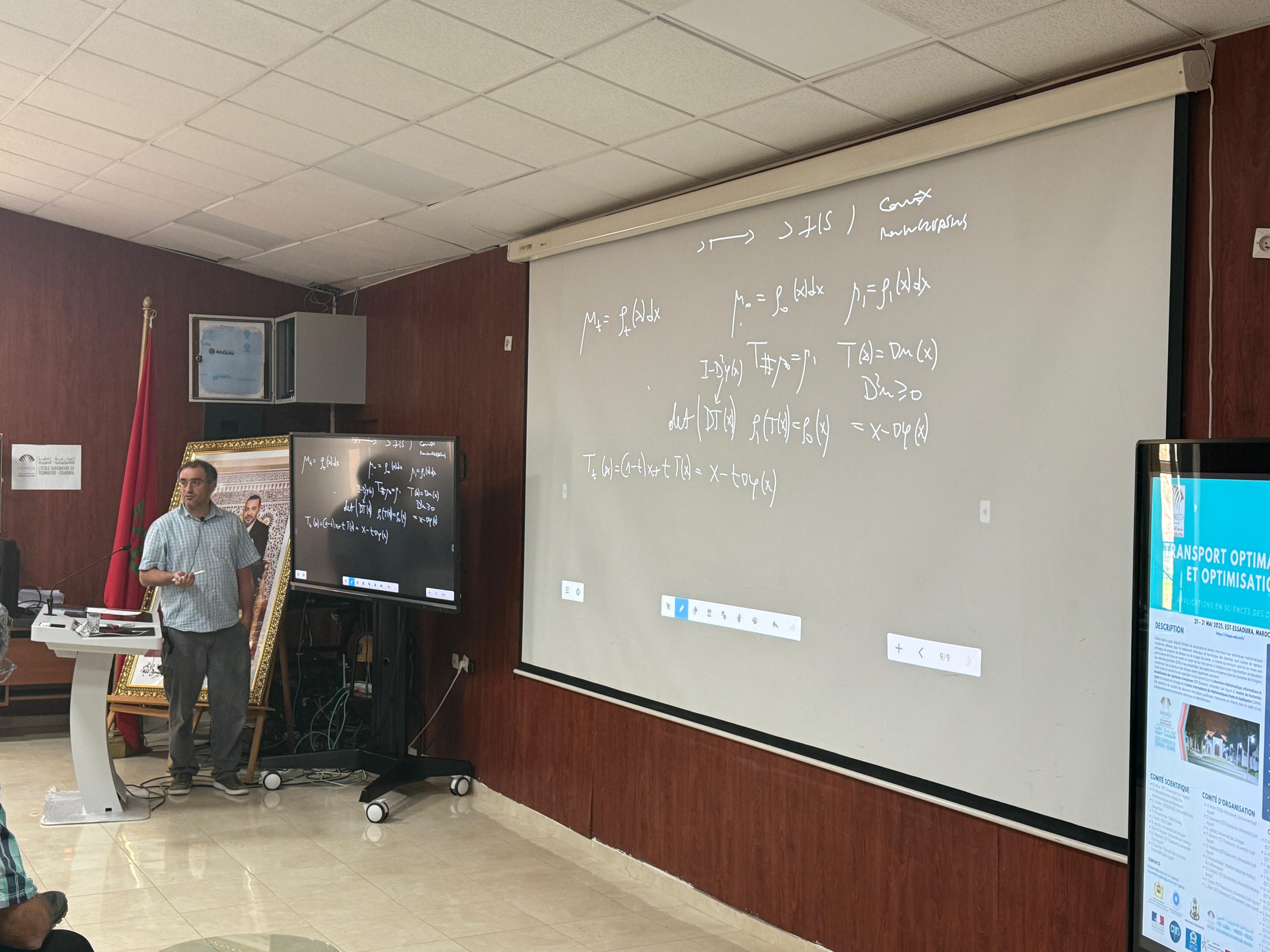

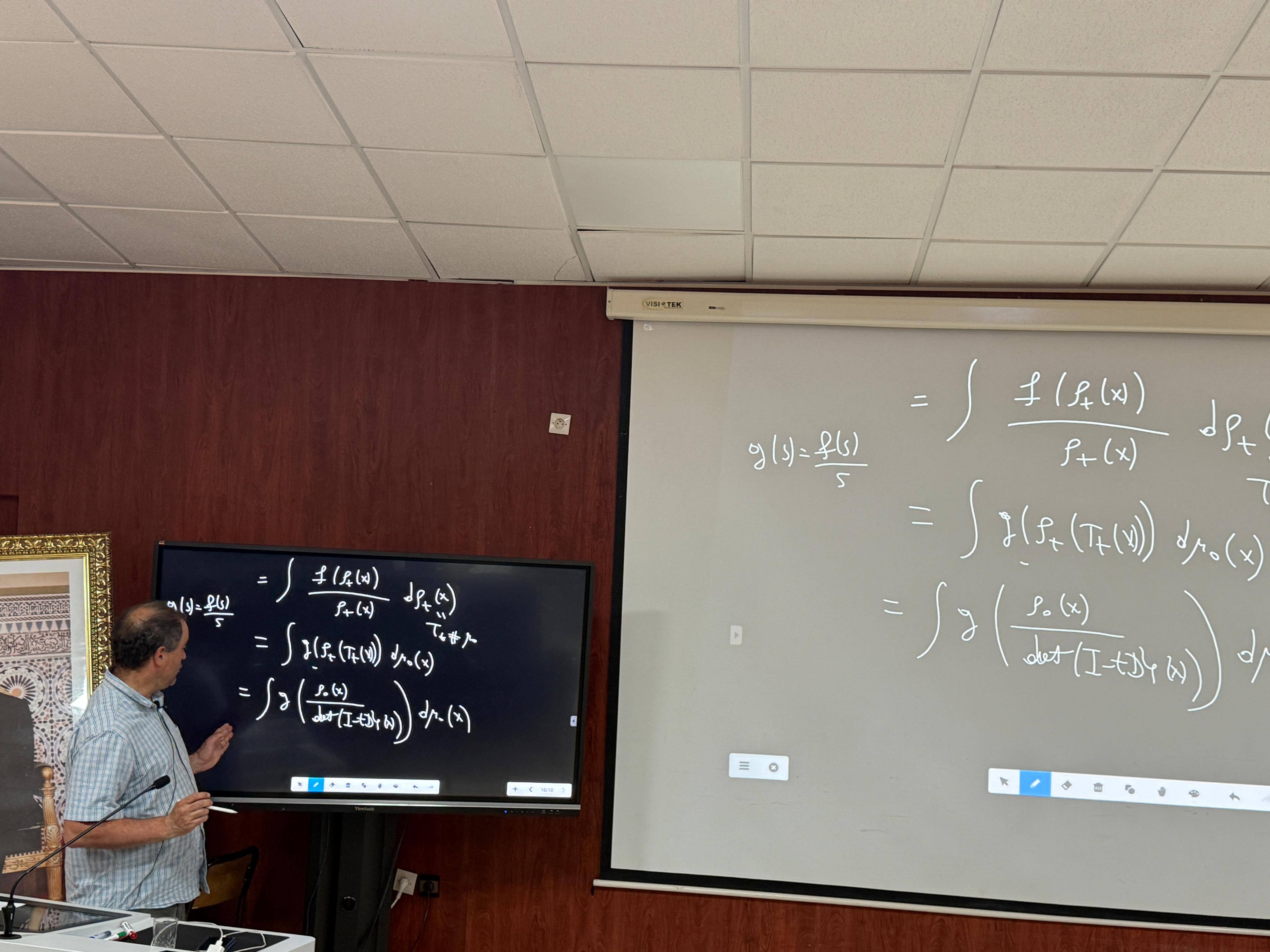

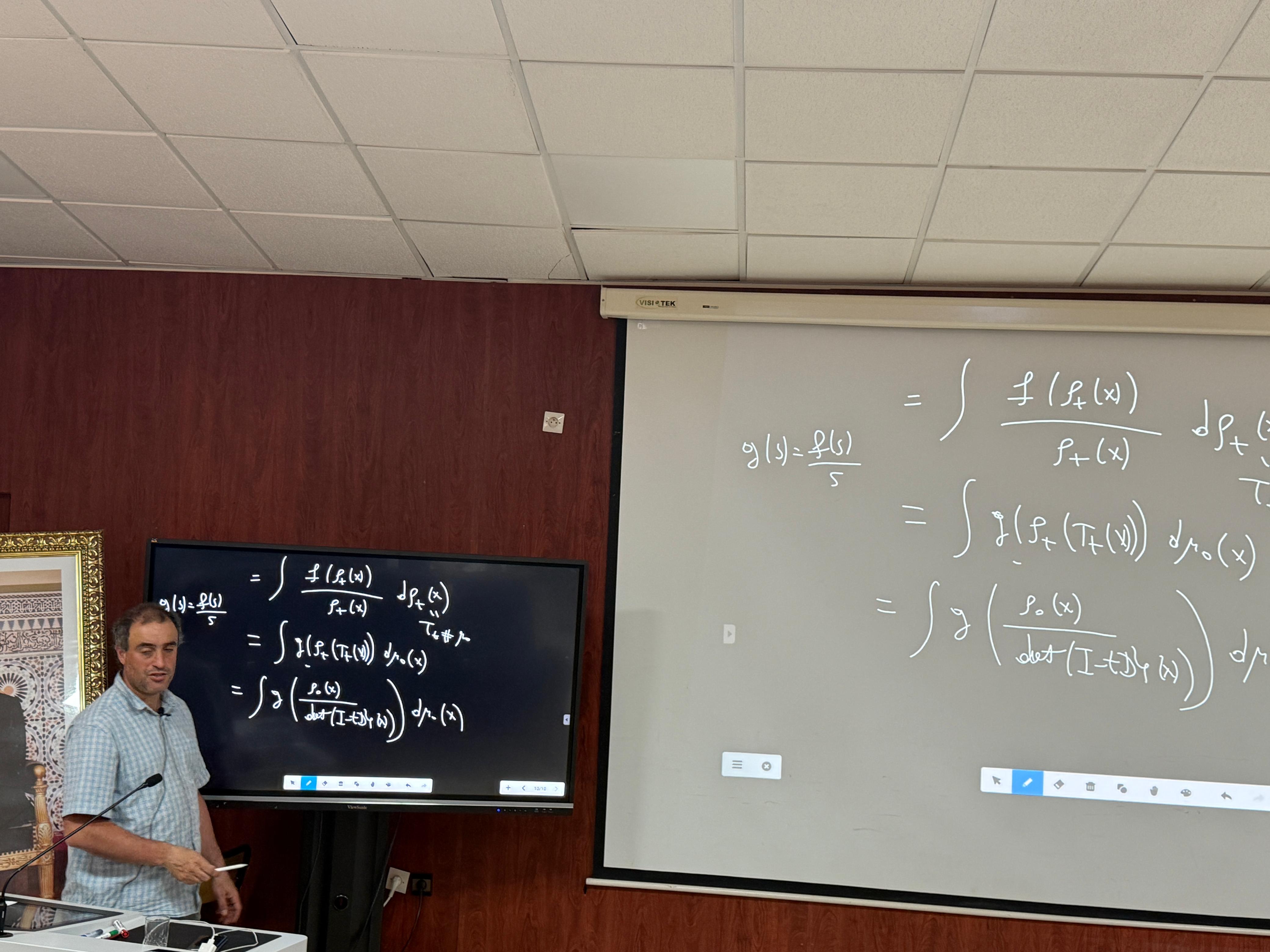

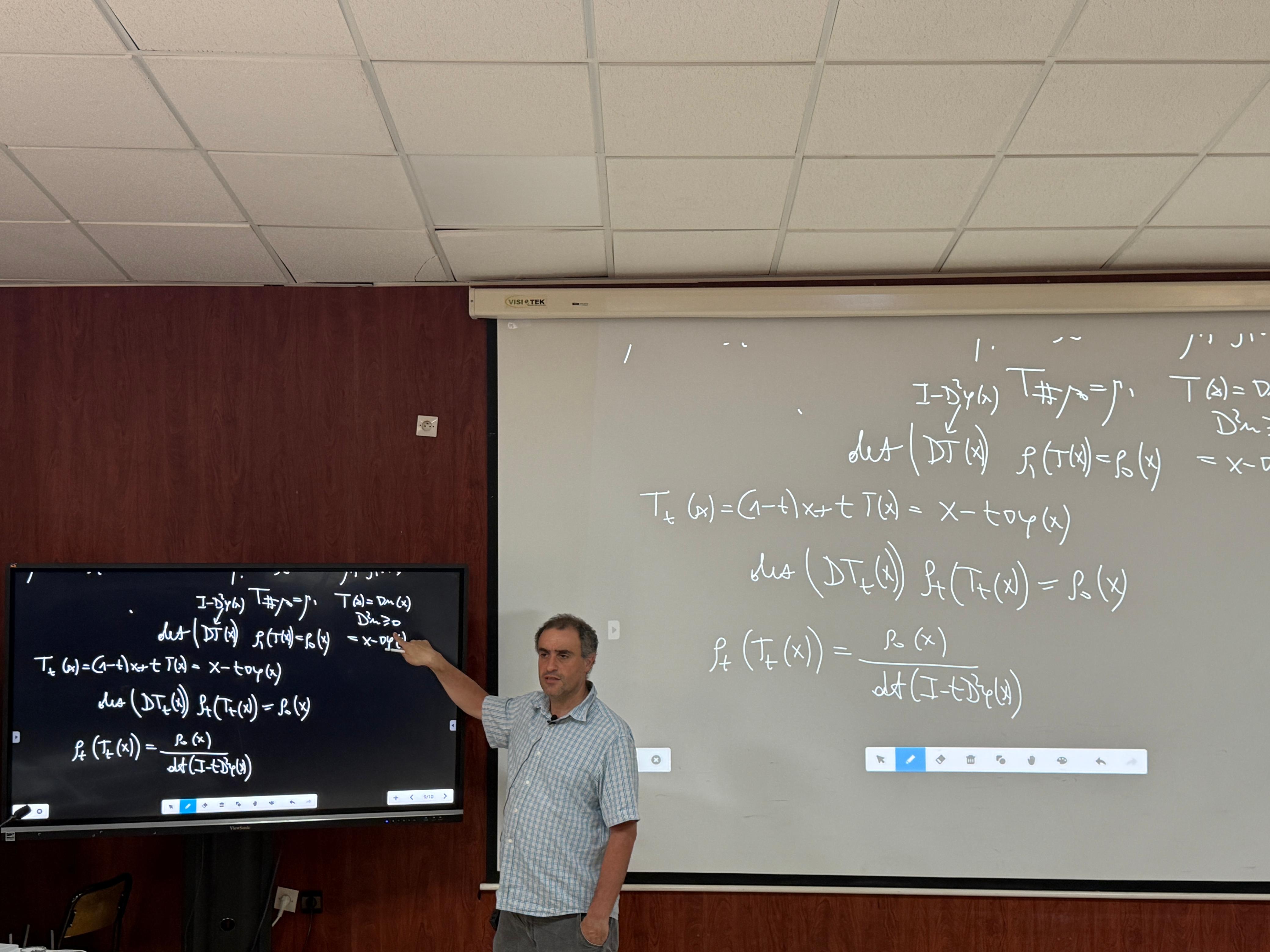

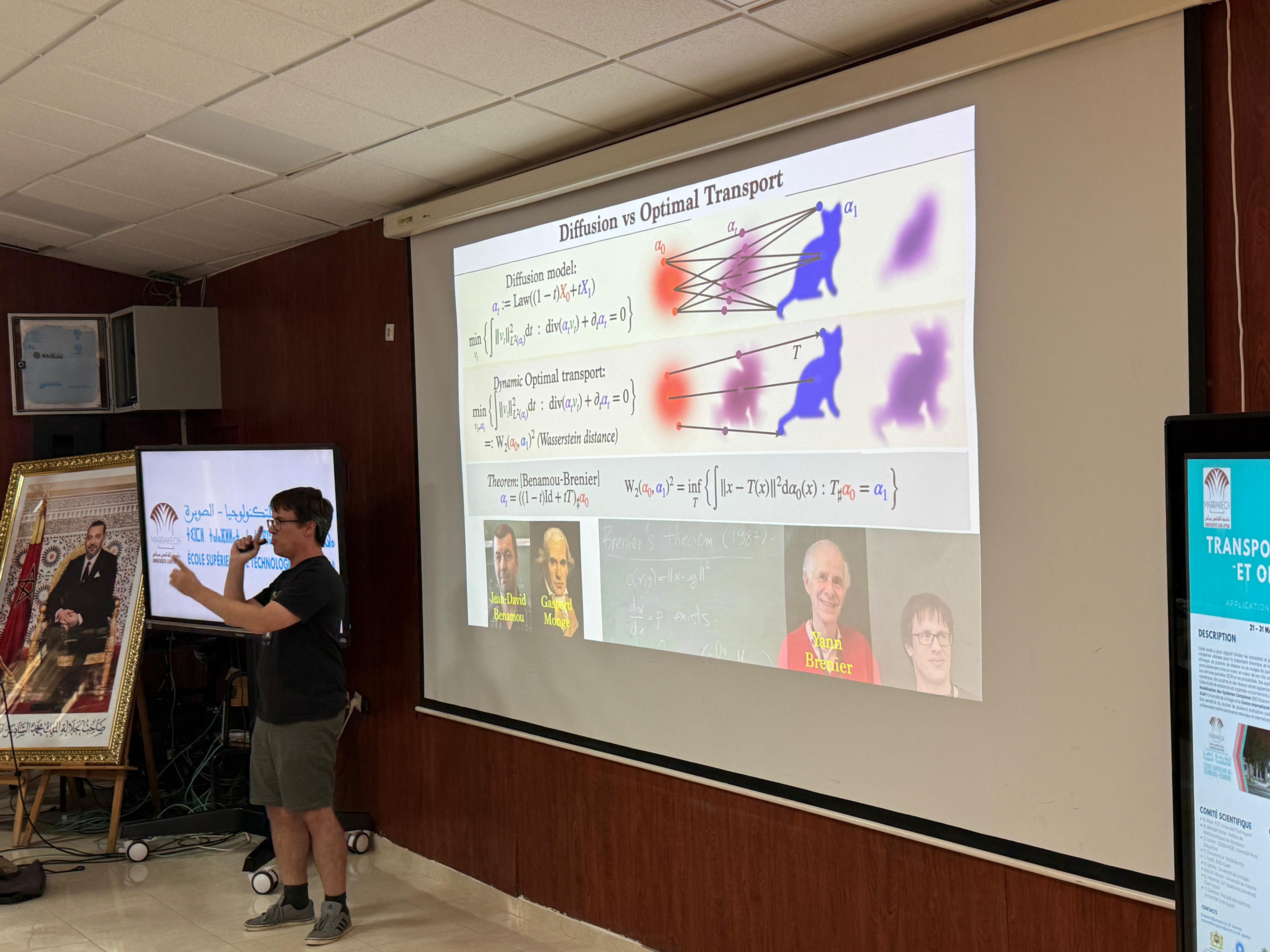

Ce cours a pour objectif de présenter une introduction assez complète au thème extrêmement fécond du transport optimal (aussi dit problème de Monge-Kantorovich) et de developper certaines de ses applications. On commencera par étudier quelques cas particuliers (le cas discret, le cas unidimensionnel) puis on introduira la dualité de Kantorovich et montrerons comment en déduire le théorème de Brenier (existence et unicité d'un transport donné par le gradient d'une fonction convexe), nous évoquerons le lien avec les équations de Monge-Ampère et certaines inégalités fonctionnelles. Nous traiterons également le cas d'un coût de transport donné par une distance et sa formulation de type flot minimal à la Beckmann.

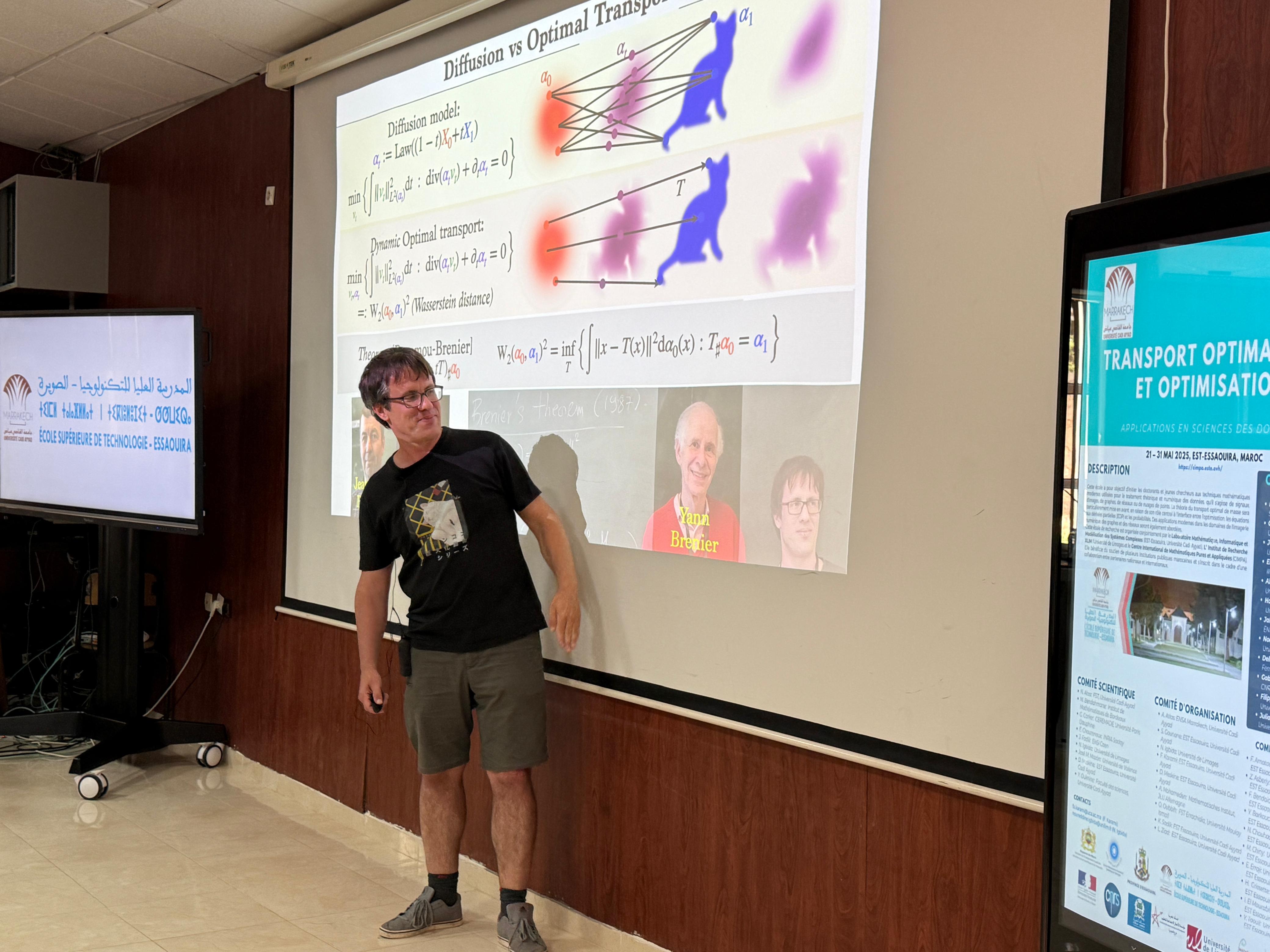

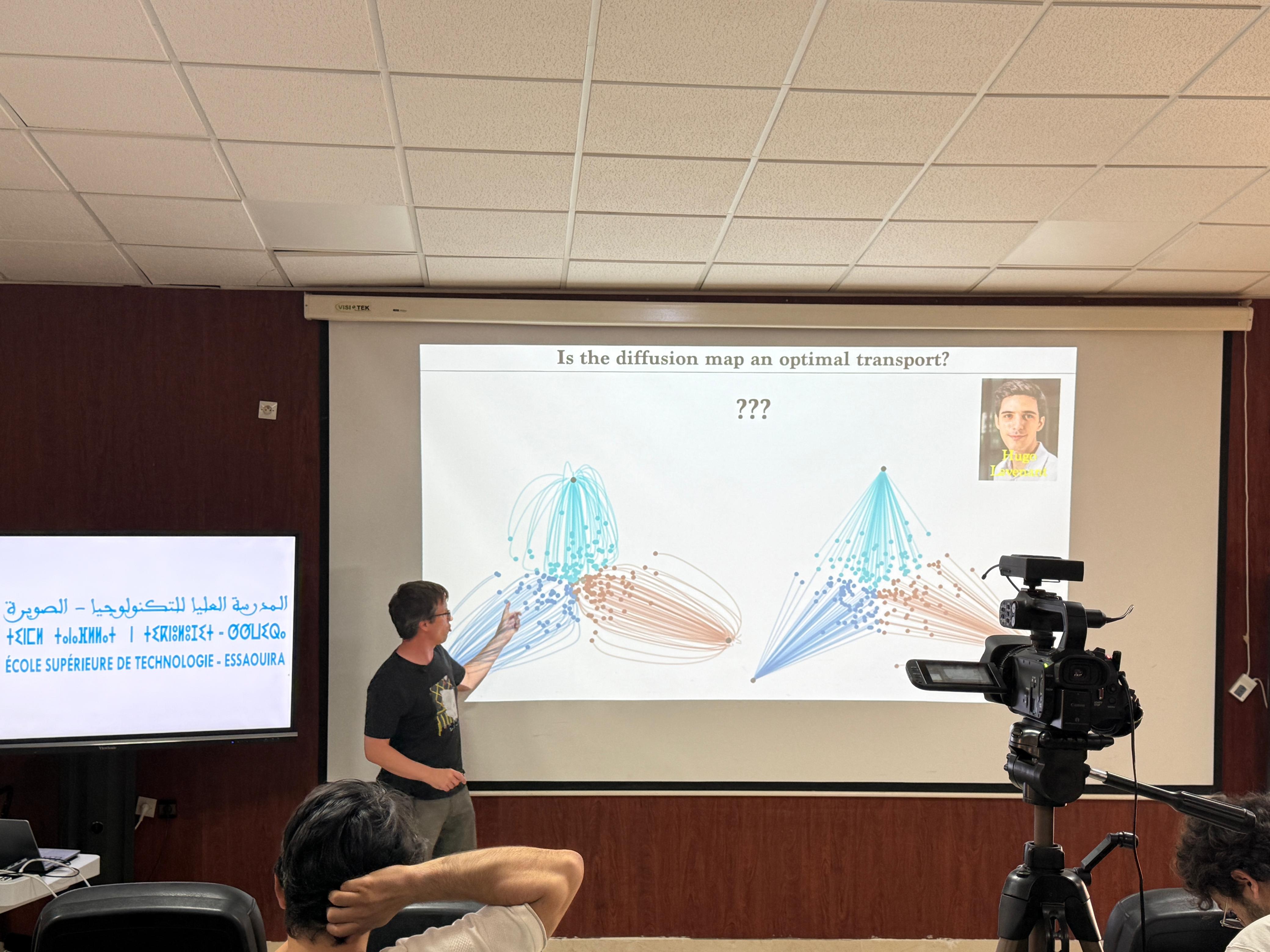

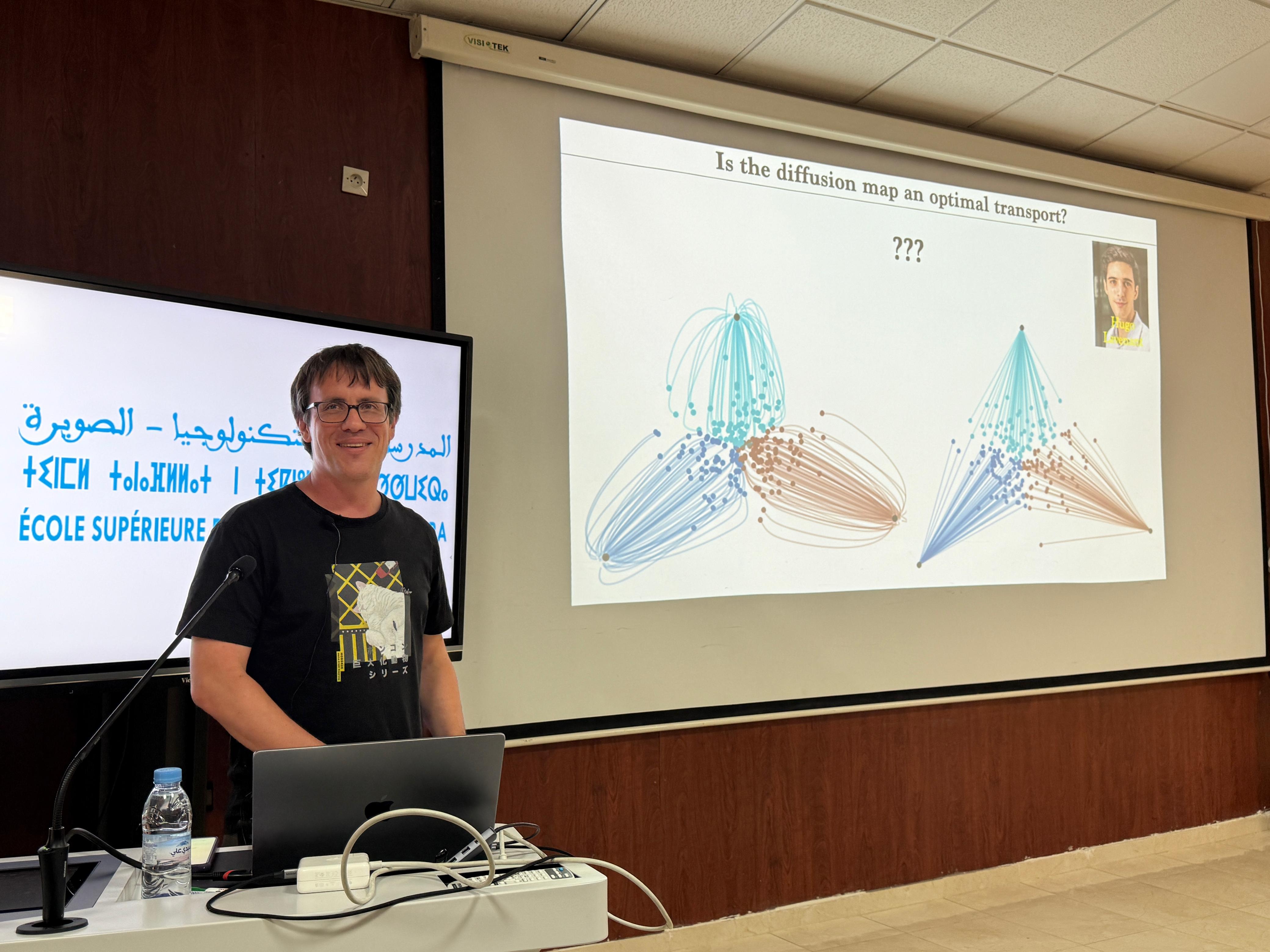

Ce cours fait suite au cours 1. Nous aborderons ici la formulation dynamique (Benamou-Brenier) du transport optimal, ce qui fera un pont naturel avec les méthodes de transport pour les équations d'évolution notamment les flots de gradients dans l'espace de Wasserstein. Nous évoquerons enfin le lien entre transport optimal et dynamique des fluides incompressibles

Le transport optimal (OT) est une théorie mathématique à l'interface entre l'optimisation, les équations aux dérivées partielles et les probabilités. Il est récemment apparu comme un outil important pour traiter une gamme étonnamment large de problèmes applicatifs, tels que la mise en correspondance de formes en imagerie médicale, les problèmes de prédiction structurée en apprentissage supervisé et l'entrainement de réseaux génératifs profonds. Dans ce cours, je ferai un tour d'horizon depuis la description de la théorie mathématique jusqu'aux développements récents des solveurs numériques qui permettent de passer à l'échelle. J'insisterai en particulier sur l’importance des récents progrès obtenus par des approches par régularisation entropique, qui permettent de s’attaquer aux problèmes d’apprentissage en grandes dimensions. Plus d'information sont disponibles en ligne via https://optimaltransport.github.io/

Le but de ces séances étant de présenter et illustrer à l'aide de simulations numériques certains exemples abordés dans le cours avancé "transport optimal computationnel".

Pour faciliter la partie code de mon cours, j’ai créé un site regroupant l’ensemble des codes que nous allons explorer ensemble. Vous pouvez y accéder via ce lien :

https://github.com/gpeyre/ot4mlL’idée est simple : pendant la séance, je resterai dans la salle de conférence pour vous montrer comment fonctionnent les différents codes. Ceux qui le souhaitent pourront directement ouvrir leur ordinateur (vous pouvez travailler à deux par ordinateur) et exécuter ces codes en ligne via Colab grâce à une connexion internet.

Mon objectif principal est de vous familiariser avec l’utilisation de ces outils, pas de vous apprendre à coder ou de vous faire résoudre des exercices. Les codes étant déjà prêts, il suffit simplement d’expérimenter avec.

Ce cours fait suite au cours 1. Nous aborderons ici la formulation dynamique (Benamou-Brenier) du transport optimal, ce qui fera un pont naturel avec les méthodes de transport pour les équations d'évolution notamment les flots de gradients dans l'espace de Wasserstein. Nous évoquerons enfin le lien entre transport optimal et dynamique des fluides incompressibles

L’intelligence artificielle (IA) est actuellement fortement mise en lumière, particulièrement depuis l’émergence de grands modèles de langage. Ces nouveaux types de réseaux de neurones présentent des défis scientifiques et sociétaux majeurs. Dans cet exposé, je ferai un tour d’horizon des avancées récentes en IA, à la fois en termes de l’architecture des réseaux de neurones, des techniques d’entraînement et des applications possibles de ces techniques. J’expliquerai pourquoi les mathématiques sont au cœur de ces révolutions. Elles sont utilisées comme le langage naturel pour décrire les processus complexes effectués par ces réseaux de neurones de nouvelle génération et pour perfectionner les méthodes d’apprentissage.

Ce cours a pour objectif de présenter une introduction assez complète au thème extrêmement fécond du transport optimal (aussi dit problème de Monge-Kantorovich) et de developper certaines de ses applications. On commencera par étudier quelques cas particuliers (le cas discret, le cas unidimensionnel) puis on introduira la dualité de Kantorovich et montrerons comment en déduire le théorème de Brenier (existence et unicité d'un transport donné par le gradient d'une fonction convexe), nous évoquerons le lien avec les équations de Monge-Ampère et certaines inégalités fonctionnelles. Nous traiterons également le cas d'un coût de transport donné par une distance et sa formulation de type flot minimal à la Beckmann.

Le transport optimal (OT) est une théorie mathématique à l'interface entre l'optimisation, les équations aux dérivées partielles et les probabilités. Il est récemment apparu comme un outil important pour traiter une gamme étonnamment large de problèmes applicatifs, tels que la mise en correspondance de formes en imagerie médicale, les problèmes de prédiction structurée en apprentissage supervisé et l'entrainement de réseaux génératifs profonds. Dans ce cours, je ferai un tour d'horizon depuis la description de la théorie mathématique jusqu'aux développements récents des solveurs numériques qui permettent de passer à l'échelle. J'insisterai en particulier sur l’importance des récents progrès obtenus par des approches par régularisation entropique, qui permettent de s’attaquer aux problèmes d’apprentissage en grandes dimensions. Plus d'information sont disponibles en ligne via https://optimaltransport.github.io/

Le but de ces séances étant de présenter et illustrer à l'aide de simulations numériques certains exemples abordés dans le cours avancé "transport optimal computationnel".

Pour faciliter la partie code de mon cours, j’ai créé un site regroupant l’ensemble des codes que nous allons explorer ensemble. Vous pouvez y accéder via ce lien :

https://github.com/gpeyre/ot4mlL’idée est simple : pendant la séance, je resterai dans la salle de conférence pour vous montrer comment fonctionnent les différents codes. Ceux qui le souhaitent pourront directement ouvrir leur ordinateur (vous pouvez travailler à deux par ordinateur) et exécuter ces codes en ligne via Colab grâce à une connexion internet.

Mon objectif principal est de vous familiariser avec l’utilisation de ces outils, pas de vous apprendre à coder ou de vous faire résoudre des exercices. Les codes étant déjà prêts, il suffit simplement d’expérimenter avec.

Le transport optimal (OT) est une théorie mathématique à l'interface entre l'optimisation, les équations aux dérivées partielles et les probabilités. Il est récemment apparu comme un outil important pour traiter une gamme étonnamment large de problèmes applicatifs, tels que la mise en correspondance de formes en imagerie médicale, les problèmes de prédiction structurée en apprentissage supervisé et l'entrainement de réseaux génératifs profonds. Dans ce cours, je ferai un tour d'horizon depuis la description de la théorie mathématique jusqu'aux développements récents des solveurs numériques qui permettent de passer à l'échelle. J'insisterai en particulier sur l’importance des récents progrès obtenus par des approches par régularisation entropique, qui permettent de s’attaquer aux problèmes d’apprentissage en grandes dimensions. Plus d'information sont disponibles en ligne via https://optimaltransport.github.io/

Le but de ces séances étant de présenter et illustrer à l'aide de simulations numériques certains exemples abordés dans le cours avancé "transport optimal computationnel".

Pour faciliter la partie code de mon cours, j’ai créé un site regroupant l’ensemble des codes que nous allons explorer ensemble. Vous pouvez y accéder via ce lien :

https://github.com/gpeyre/ot4mlL’idée est simple : pendant la séance, je resterai dans la salle de conférence pour vous montrer comment fonctionnent les différents codes. Ceux qui le souhaitent pourront directement ouvrir leur ordinateur (vous pouvez travailler à deux par ordinateur) et exécuter ces codes en ligne via Colab grâce à une connexion internet.

Mon objectif principal est de vous familiariser avec l’utilisation de ces outils, pas de vous apprendre à coder ou de vous faire résoudre des exercices. Les codes étant déjà prêts, il suffit simplement d’expérimenter avec.

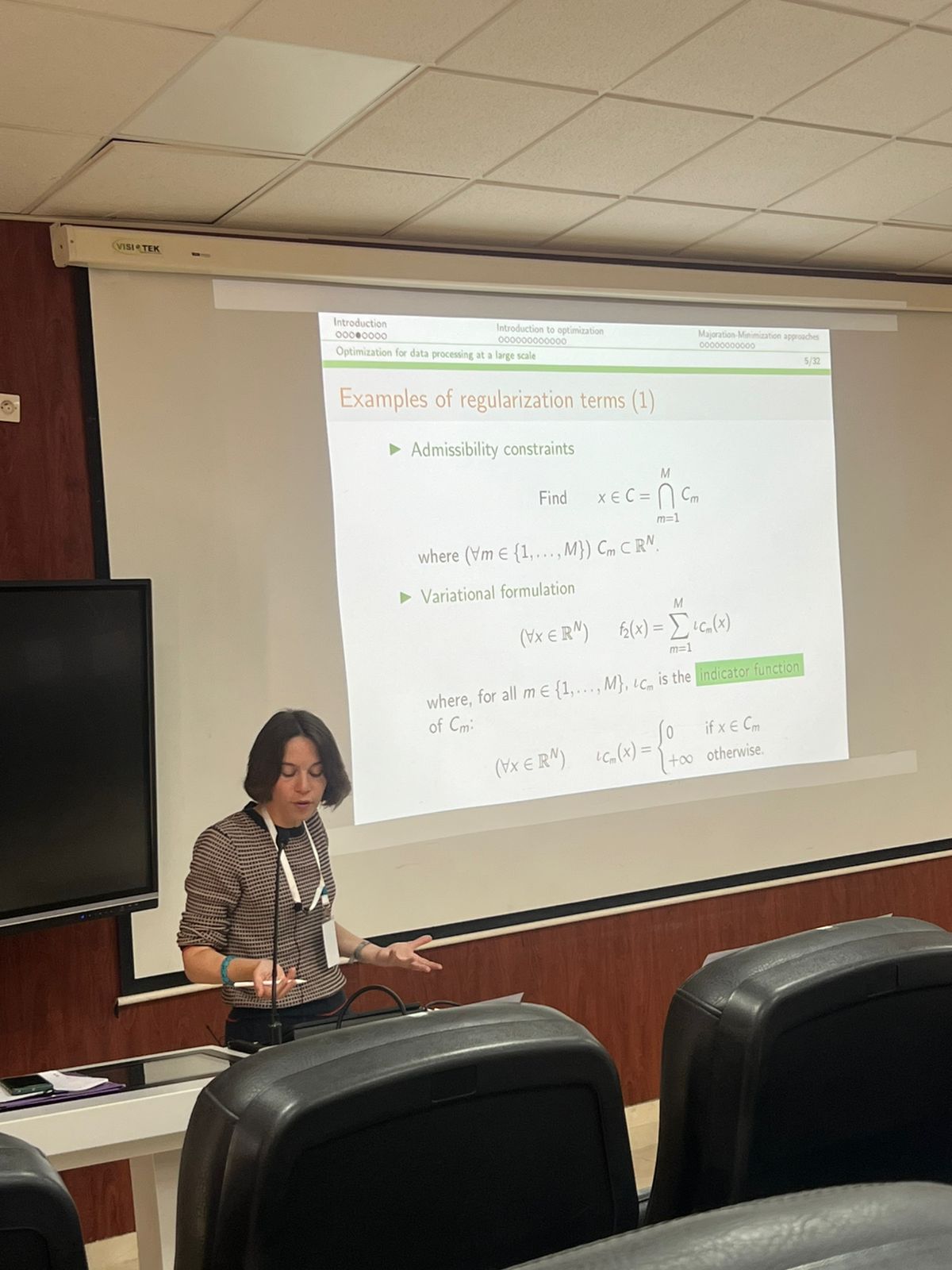

L'optimisation, en particulier non-lisse, est omniprésente dans les méthodes moderne de traitement et d'analyse de données (signal, image, graphe, nuage de points, etc.), ainsi qu'en apprentissage statistique. En effet, l'immense majorité des problèmes dans ces domaines d'application se ramènent à l'optimisation d'une fonctionnelle non-lisse mais structurée, possiblement non-convexe, en très grande dimension (voire en dimension infinie). Ce cours fournira les outils nécessaires en analyse et optimisation non-lisses pour résoudre de tels problèmes d'optimisation en tirant parti de leur structure. On décrira à la fois les outils mathématique sous-jacents, les algorithmes, ainsi que leurs garanties théoriques notamment de convergence. On se focalisera en particulier sur les algorithmes dits d'éclatement d'opérateurs. Des séances de travaux pratiques seront consacrés à l'implémentation de ces algorithmes.

Ces séances de travaux pratiques, relatives au cours "Optimisation en traitement des données", seront consacrées à l'implémentation de certains algorithmes, notamment les algorithmes dits d'éclatement d'opérateurs.

L'optimisation, en particulier non-lisse, est omniprésente dans les méthodes moderne de traitement et d'analyse de données (signal, image, graphe, nuage de points, etc.), ainsi qu'en apprentissage statistique. En effet, l'immense majorité des problèmes dans ces domaines d'application se ramènent à l'optimisation d'une fonctionnelle non-lisse mais structurée, possiblement non-convexe, en très grande dimension (voire en dimension infinie). Ce cours fournira les outils nécessaires en analyse et optimisation non-lisses pour résoudre de tels problèmes d'optimisation en tirant parti de leur structure. On décrira à la fois les outils mathématique sous-jacents, les algorithmes, ainsi que leurs garanties théoriques notamment de convergence. On se focalisera en particulier sur les algorithmes dits d'éclatement d'opérateurs. Des séances de travaux pratiques seront consacrés à l'implémentation de ces algorithmes.

Ces séances de travaux pratiques, relatives au cours "Optimisation en traitement des données", seront consacrées à l'implémentation de certains algorithmes, notamment les algorithmes dits d'éclatement d'opérateurs.

L'optimisation, en particulier non-lisse, est omniprésente dans les méthodes moderne de traitement et d'analyse de données (signal, image, graphe, nuage de points, etc.), ainsi qu'en apprentissage statistique. En effet, l'immense majorité des problèmes dans ces domaines d'application se ramènent à l'optimisation d'une fonctionnelle non-lisse mais structurée, possiblement non-convexe, en très grande dimension (voire en dimension infinie). Ce cours fournira les outils nécessaires en analyse et optimisation non-lisses pour résoudre de tels problèmes d'optimisation en tirant parti de leur structure. On décrira à la fois les outils mathématique sous-jacents, les algorithmes, ainsi que leurs garanties théoriques notamment de convergence. On se focalisera en particulier sur les algorithmes dits d'éclatement d'opérateurs. Des séances de travaux pratiques seront consacrés à l'implémentation de ces algorithmes.

Ces séances de travaux pratiques, relatives au cours "Optimisation en traitement des données", seront consacrées à l'implémentation de certains algorithmes, notamment les algorithmes dits d'éclatement d'opérateurs.

This mini-course offers a comprehensive exploration of linear diffusion equations on metric graphs. In my lectures I will delve into four key topics:

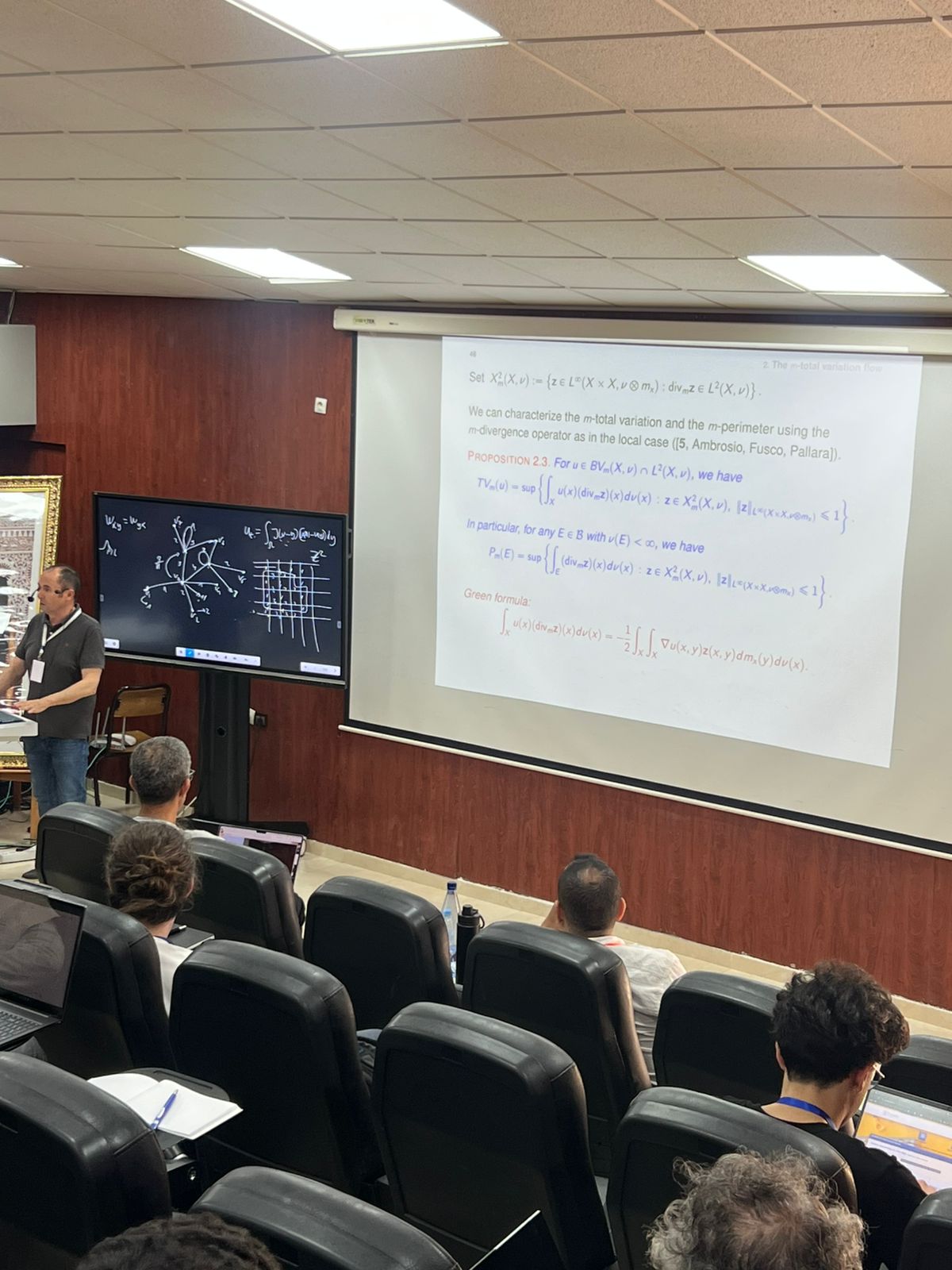

We will study different diffusion problems in the workspace of metric random walk spaces, which include particularly discrete weighted graphs, and different aspects related to the operators involved in such problems. For example, we will study a ROF model and the corresponding gradient descent method in metric random walk spaces, which involves the study of the 1-Laplacian in such spaces.

This mini-course offers a comprehensive exploration of linear diffusion equations on metric graphs. In my lectures I will delve into four key topics:

This mini-course offers a comprehensive exploration of linear diffusion equations on metric graphs. In my lectures I will delve into four key topics:

We will study different diffusion problems in the workspace of metric random walk spaces, which include particularly discrete weighted graphs, and different aspects related to the operators involved in such problems. For example, we will study a ROF model and the corresponding gradient descent method in metric random walk spaces, which involves the study of the 1-Laplacian in such spaces.

We will study different diffusion problems in the workspace of metric random walk spaces, which include particularly discrete weighted graphs, and different aspects related to the operators involved in such problems. For example, we will study a ROF model and the corresponding gradient descent method in metric random walk spaces, which involves the study of the 1-Laplacian in such spaces.

CIMPA School 2025 - Essaouira, Morocco

CIMPA School

CIMPA School

Les conférenciers seront hébergés à l'Hôtel Miramar.

Site Web : https://www.miramaressaouira.com/

Téléphone : +212 524 47 58 52

L'hébergement sera assuré à la Résidence Al Modarris d'Essaouira.

Localisation : voir sur Google Maps

Vidéo : Lien vers la vidéo

Plusieurs options d'hébergement sont disponibles :

Des appartements sont également disponibles à louer au voisinage de l'école au tarif d’environ 250 DH par nuit.